Durante décadas, la idea de una “singularidad tecnológica” ha despertado tanto fascinación como temor. El concepto, en pocas palabras, describe un momento en el que la inteligencia artificial (IA) supere la capacidad intelectual humana, provocando cambios tan profundos que la vida como la conocemos será irreconocible. ¿Será ese momento un salto al paraíso o un abismo sin retorno? Sam Altman, CEO de OpenAI, plantea una posibilidad más esperanzadora y matizada en su ensayo The Gentle Singularity (“La singularidad suave”). En lugar de un quiebre caótico y hostil, imagina un futuro en el que la IA acelera el progreso humano sin despojarnos de lo que nos hace humanos.

El cambio ya está en marcha

Altman no habla del futuro lejano: habla del presente. La transformación impulsada por la IA ya comenzó, y aunque aún estamos en etapas tempranas, las repercusiones son visibles. Desde herramientas de productividad hasta sistemas de recomendación, la IA se infiltra en todos los aspectos de nuestra vida. Pero lo más importante es que todavía tenemos la oportunidad de guiar este proceso.

La singularidad suave no es una utopía sin conflictos, sino un cambio de paradigma que puede resultar beneficioso si lo conducimos con cuidado. Esto implica reconocer que la inteligencia artificial no es un ente independiente, sino una creación humana que refleja nuestras decisiones, valores y prioridades.

La IA como multiplicador humano

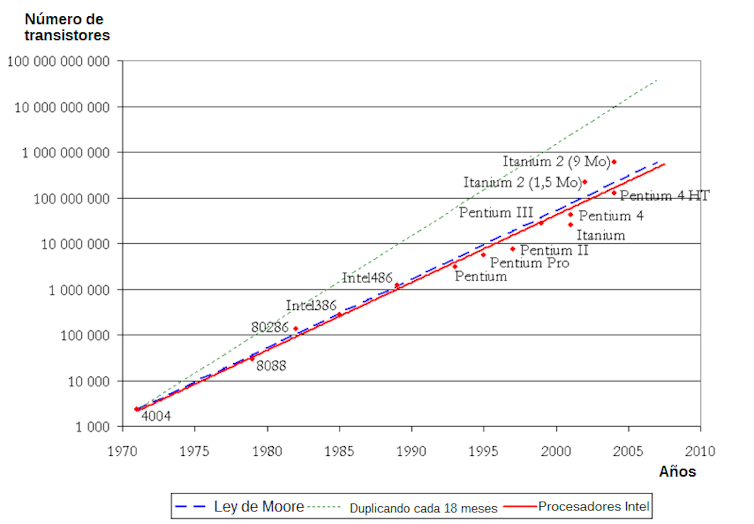

Uno de los argumentos centrales de Altman es que la IA puede actuar como un “multiplicador de inteligencia humana”. Así como el microscopio amplió nuestra visión del mundo microscópico o Internet expandió el acceso al conocimiento, la IA tiene el potencial de aumentar nuestra creatividad, productividad y capacidad de resolver problemas complejos.

La clave, según Altman, está en asegurarse de que el beneficio sea compartido. Para evitar que la IA se convierta en una herramienta de concentración de poder —ya sea en manos de gobiernos o corporaciones—, se necesita una gobernanza justa y transparente, acompañada de instituciones nuevas o adaptadas al desafío.

Riesgos reales, decisiones urgentes

Altman no ignora los riesgos. Advierte sobre la posibilidad de que la IA sea mal utilizada para el control social, la desinformación, la vigilancia masiva o la manipulación económica. También reconoce el impacto que tendrá sobre el trabajo humano y la estructura social.

Pero lo más peligroso, afirma, no es la tecnología en sí, sino nuestra inacción o dirección equivocada. Si no tomamos decisiones deliberadas hoy —sobre transparencia, distribución de beneficios, derechos digitales y regulación responsable— podríamos terminar con un sistema que reemplace a los humanos en lugar de empoderarlos.

Una oportunidad histórica

“La singularidad suave” es más que una expresión elegante: es un llamado a la responsabilidad. Altman nos invita a imaginar una sociedad en la que la abundancia generada por la IA no sea privilegio de unos pocos, sino una base para el florecimiento humano generalizado.

El desafío no es técnico, sino ético y político. Implica decidir qué queremos preservar de nuestra humanidad y cómo queremos evolucionar como especie. En este escenario, la IA no es el protagonista, sino el instrumento. Los verdaderos agentes del cambio somos nosotros.

La singularidad no tiene por qué ser una explosión descontrolada ni una pesadilla distópica. Puede ser suave, humana y colaborativa. Pero solo si decidimos activamente construirla así.

¿Estamos preparados para liderar ese camino?