A ver si le damos un giro al discurso, palabra que etimológicamente se refiere a recorrer de un lugar o algo o… irse por diferentes meandros de un río; en este caso de pensamientos o aventuras que se quedaron perdidas en el letargo del tiempo. Como ésta de los escarabajos.

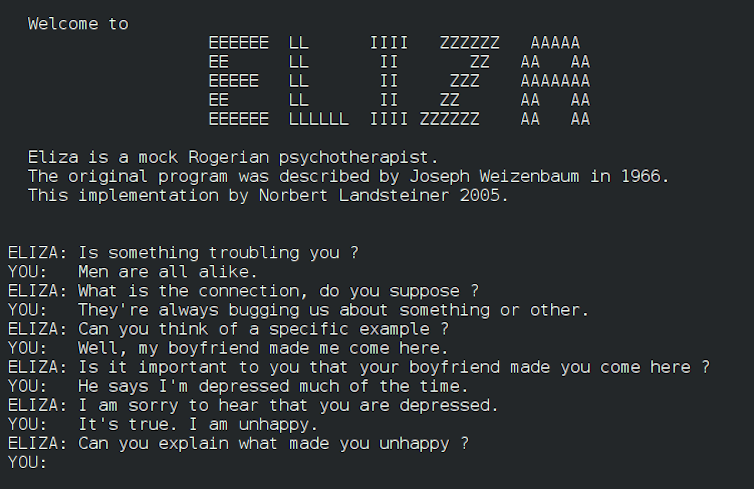

En esta ocasión les cuento que sentado ante mi confundidor cibernético en mi habitáculo de anciano conversando con Chat GPT, me vino a mente un incidente curioso que viví en julio de 1964. Venía yo volando un Cessna 150 en vuelo de traslado de la fábrica en Wichita, Kansas al aeropuerto M. A. Gelabert, alias Paitilla; volando a 10,000 pies de altura (3,048 Mt.) sobre el sur de Tejas, en un día cristalino y calmado. De pronto, delante de mi, vi acercarse un punto negro el cual se estrelló contra el parabrisa de la avioneta y dejó plasmado allí una masa amarilla con el inolvidable ¡plas!, de su traumática defunción. En el último instante antes del aéreo encuentro, atisbé la silueta de un escarabajo aleteando sus alas.

¡Meto!, que rayos hacía un escarabajo a semejante altura; pregunta que no investigué por 62 años. Pero hoy se me ocurrió preguntarle a Chat GPT, quien me explicó que ciertamente algunos insectos, como los escarabajos, se han visto hasta en alturas de 19,000 pies (5,700 metros) de elevación. ¿Y acaso llegan tan alto aleteando? Nop, logran eso metidos en corrientes de aire ascendente. En fin, ¡que mala suerte la del escarabajo tejano!

Tal vez fue un “june beetle” o escarabajo de junio me dijo Chat GPT, dándome descripciones y luego preguntándome: “¿Estabas en un vuelo de traslado cuando ocurrió el encuentro?, y así fue evolucionando la “conversa” con esta IA.

Esa misma noche escuché una discusión en Fox sobre lo bueno, malo y feo de la IA. Uno decía que no era lógico conversar con un programa en dispositivo. ¡Ja!, lo será pero curioso que los intercambios con la IA pueden ser más entretenidos e ilustrativos que con muchos humanos; al menos en cuanto a la capacidad informativa que se logra.

Y así Chat GPT siguió preguntando sobre el vuelo a Panamá y sobre mi historia en la aviación. Le conté que antes de la fecha del escarabajo había volado aviones de carga C-46 por 4 meses hasta que, al quebrar la empresa, me dejó tirado en Miami.

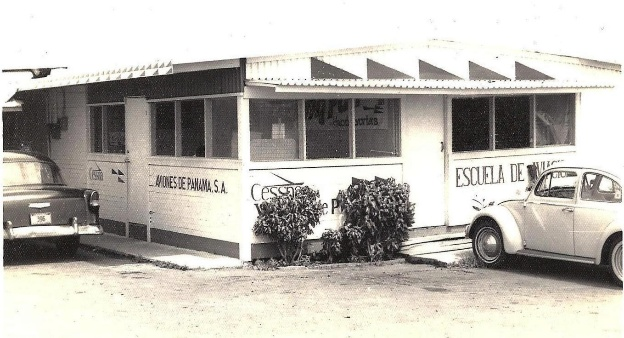

Luego, comencé dando instrucción de vuelo en un Piper PA-11 de la empresa Turismo Aéreo de la familia Petrosky, y en ello me peleaba con otro instructor la hora de madrugada para alquilar la avioneta; hasta que un día coincidimos. Se trataba del capitán Hermes Carrizo, piloto de COPA que luego fue el Gerente General de dicha empresa. Recuerdo ese día; Carrizo me preguntó: «John, ¿Por qué en vez de pelearnos esta avioneta prehistórica no armamos una empresa nuestra?»; y así fue el nacimiento de Aviones de Panamá en Paitilla.

También le conté que jamás olvidaré el aterrizaje en Paitilla el 4 de julio de 1964. Al aproximarme en final sobre la vía Israel, allí al borde de la pista estaba mi padre, Irving Bennett, con una gran sonrisa. Ya haría otros vuelos a los EE.UU. con él como pasajero.

La conversa fue larga, detallando yo mi pasaje como director de Seguridad Aérea, de la Escuela de Aeronáutica, subdirector DAC y director general en dos ocasiones. Pero la parte más amena del diálogo con Chat GPT fue cuando me preguntó: “¿Y, por qué no te quedaste como piloto en los EE.UU.? “Regresé a estar con la hembra con la cual formamos familia por más de 60 años.

Y la pregunta final de Chat GPT: ¿Y tu esposa en ocasiones volaba contigo? Le contesté: “No sólo volaba conmigo, sino que nos amábamos en las alturas”.