La palabra “inteligencia” tiene que ver con la facultad del entendimiento, el saber y la comprensión, razón por la cual el nombrecito de “inteligencia artificial” o AI es irreal o sacado de los pelos; y, bien vale la pena ahondar en el asunto ya que casi todos, sino todos, los problemas de la humanidad surgen a partir del mal uso de las palabras. El asunto lo pintaron desde la Biblia en la parábola de la Babel, como también en el decir “Dios es Palabra”. Pero el tema se torna mucho más embrollado debido a que la llamada AI es uno de los factores más impactantes de la singularidad que deviene la humanidad hoy día. Que, si la manzana la podemos usar para bien o mal, ni se diga la AI, la cual nos puede llevar al Paraíso o al mismo Infierno. En fin, el vocablo “artificial” también es primo del vocablo “artificio”, vocablo que indica falta naturalidad.

El asunto gira es que la AI no puede hacer conexiones mentales creativas y si usamos esa herramienta como y para lo que no es, los resultados pueden ser terribles. En resumen, los humanos no nos salvamos de ser los gestores de nuestro destino; sea brillante o lúgubre. Jamás olvido el dicho que lo dice todo respecto a las computadoras: “si les metes basura, te responden con basura”. Pero el peligro va mucho más allá porque en el juego de póker que es la vida, el pote o “pot” hoy día es más grande que jamás en la historia humana.

La AI funciona con analogías o semejanzas y los científicos han visto que la AI no se gana al ser humano resolviendo problemas de matrices, que son formaciones numéricas u de otros objetos matemáticos, conocidos como entradas de la matriz, que requieren un sentido que no tiene la AI. El problema comienza cuando pretendemos usar la AI para lo que no es y, de salida, cuando le ponemos un nombre que tampoco es. Tal es el caso del llamado “metrobus” de Panamá, que no es tal cosa; de manera que si lo tratas de usar para resolver los problemas de tránsito y transporte, te ira muy mal… ¿o es que no lo hemos notado?

Otro aspecto que debemos considerar cuando intentamos, erróneamente, comparar al ser humano con la AI, es que nuestras prácticas educativas en siglos recientes, ha sido terribles y la humanidad, en muchos sentidos, ha perdido capacidad intelectual. Hoy día ya contamos con el entendimiento y capacidad de tornar a todo niño en genio; pero, insistimos en delegar y centralizar la educación; más que nada, con fines de adoctrinamiento y fines politiqueros.

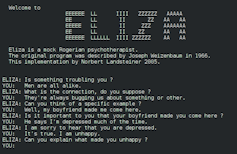

Y para mayor ilustración del tema, tomemos el caso de el “aprendizaje de disparo cero o ‘Zero-shot learning’, que es una técnica de aprendizaje automático que permite a un modelo reconocer y clasificar objetos o conceptos sin haberlos visto previamente durante el entrenamiento, utilizando información semántica y transferencias de conocimiento. ¿Me explico o me entiende el lector? ¿No? No se preocupen, que a mí tampoco me queda muy claro el asunto.

Y, para resumir y enredarles más, termino comentando algo sobre el razonamiento analógico. Una cosa es intentar comprensión a base de razonamiento abstracto en contraposición del atajo de resolver incógnitas basándose en conocimientos que no fueron dados durante las clases o los estudios; conocimientos que ya tenías en tu alacena mental. ¿Puede la AI resolver cuándo no le has provisto toda la información? Por ejemplo; Einstein resolvió o imaginó la Teoría de la Relatividad cuando mentalmente montó un rayo de luz en el espacio.