Abordo en este análisis reflexiones sobre las posibles implicaciones y retos del desarrollo y acceso generalizado a la inteligencia artificial de textos, en boca de tantos tras la activación a finales de noviembre de la herramienta ChatGPT, en acceso abierto.

Incorporo nota metodológica al final.

Transformación de negocios con la IA de textos

El desarrollo de la IA de ChatGPT tiene el potencial de cambiar significativamente la forma en que la gente interactúa con la tecnología.

Puede mejorar la eficiencia y precisión en tareas que requieren una interacción natural con el lenguaje humano. Por ejemplo, puede tener un impacto en la atención al cliente y la atención médica, ya que puede mejorar la eficiencia y precisión en la interacción con los clientes y pacientes.

También puede tener un impacto en el sector financiero, ya que puede ayudar a realizar análisis y predicciones más precisos en el mercado financiero.

Además, puede tener un impacto en el sector educativo, ya que puede utilizarse para crear programas de enseñanza personalizados y adaptativos.

La IA también puede ser utilizada para crear herramientas y soluciones innovadoras en áreas como la logística, la energía y la producción.

Mapa de riesgos

Hay varios posibles riesgos y desafíos asociados con el desarrollo de la IA, como la privacidad y la seguridad de la información.

Uno de los principales riesgos es la posibilidad de que la información personal sea recopilada, almacenada y utilizada de manera indebida por parte de terceros. Esto puede ocurrir a través de ataques cibernéticos, uso no autorizado de la información por parte de empleados de la empresa o incluso a través de vulnerabilidades en el propio software de la IA.

Además, la IA también puede ser utilizada para fines malintencionados, como el spamming, el phishing o la difusión de noticias falsas. Por lo tanto, es importante desarrollar medidas de seguridad efectivas para proteger la privacidad y la seguridad de la información en el contexto del desarrollo de la IA.

Medidas de seguridad

Hay varias medidas de seguridad que pueden ser efectivas para proteger la privacidad y la seguridad de la información en el contexto del desarrollo de la IA.

- Implementar medidas de cifrado efectivas para proteger la información contra el acceso no autorizado.

- Establecer políticas de privacidad claras y transparentes para informar a los usuarios sobre cómo se recopila, almacena y utiliza su información personal.

- Realizar regularmente auditorías y pruebas de seguridad para detectar y corregir vulnerabilidades en el software de la IA.

- Capacitar y educar a los empleados sobre las buenas prácticas de seguridad informática y las políticas de privacidad de la empresa.

- Colaborar con expertos en seguridad informática y privacidad para desarrollar medidas efectivas y estar al día con las últimas amenazas y tendencias en el campo de la seguridad de la IA.

Es importante tener en cuenta la seguridad y la privacidad en todas las etapas del desarrollo de la IA, desde el diseño hasta la implementación y el mantenimiento, para garantizar la protección adecuada de la información personal.

El papel del Estado

Los gobiernos y la legislación tienen la responsabilidad de establecer marcos y normas para regular el desarrollo y el uso de la IA. Esto incluye la creación de leyes y regulaciones que protejan la privacidad y la seguridad de la información, así como la promoción de la ética y la transparencia en el desarrollo y uso de la IA. También pueden fomentar la investigación y el desarrollo en el campo de la IA, así como establecer estándares y mecanismos de evaluación para garantizar que la IA cumpla con ciertos requisitos de calidad y seguridad.

Retos para la prensa

El desarrollo de la IA en general, y de ChatGPT en particular, puede tener un impacto positivo en la generación de contenidos informativos y en la prensa.

Por ejemplo, ChatGPT y otras tecnologías de IA pueden ayudar a los periodistas a crear contenido más rápido y preciso, lo que les permite enfocarse en otras tareas importantes, como la investigación y la verificación de hechos.

Además, la IA también puede ayudar a la prensa a llegar a una audiencia más amplia y ofrecer contenido personalizado a sus lectores.

Sin embargo, es importante tener en cuenta que la IA todavía tiene limitaciones y no puede reemplazar completamente el trabajo humano en la generación de contenidos informativos.

Es posible que el desarrollo de la IA como ChatGPT pueda tener algún efecto negativo en la prensa. Si se utiliza en exceso o de manera inadecuada, la IA puede generar contenido que no sea preciso o que incluso sea engañoso. Además, si se utiliza para reemplazar completamente el trabajo humano en la generación de contenidos informativos, esto podría llevar a una reducción en la calidad del contenido y en la diversidad de opiniones en la prensa. Por lo tanto, es importante utilizar la IA de manera responsable y en combinación con el trabajo humano en la prensa.

Nota metodológica:

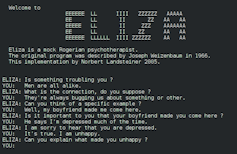

Este análisis ha sido redactado completamente con los textos generados por la herramienta de inteligencia artificial de textos ChatGPT, de acceso abierto en varios países, activada hace unos pocos días.

La única intervención del firmante de este artículo es la entrada inicial, así como formular la serie de preguntas a ChatGPT para que produzca los textos.

De los textos generados he seleccionado los que me han parecido más relevantes bajo mi criterio, haciendo puro “Copiar y pegar”, sin añadir ni una sola palabra mía.

El título también es de la herramienta. He tenido que introducir únicamente una corrección, del número de un artículo determinado.![]()

Francesc Pujol, Profesor en la Facultad de Económicas, Universidad de Navarra

Este artículo fue publicado originalmente en The Conversation. Lea el original.